Jön az AI és a Google SGE a kereséseknél: lesz még értelme a SEO-nak?

A Google SGE-vel (Search Generative Experience) a “tízes találati oldalakon” is megjelenik a mesterséges intelligencia. A folyamat pedig nyilván itt nem áll meg. Meddig van még értelme a hagyományos keresőoptimalizálásnak?

Jó pár országban és nyelven már elérhető a Google SGE a találati oldalakon, de már régóta működik a Microsoft Copilot is keresési célokra, illetve bármely mesterséges intelligenciával meghajtott csevegő-alkalmazás is jó megoldás lehet keresésre. Az AI-alapú keresés tehát elindult hódító útjára, és Sundar Pichai, a Google és az Alphabet vezérigazgatója szerint az embereknek eddigi tapasztalataik szerint tetszik is a dolog, úgyhogy ebbe az irányba tartanak.

Elfoglalja a keresést az AI

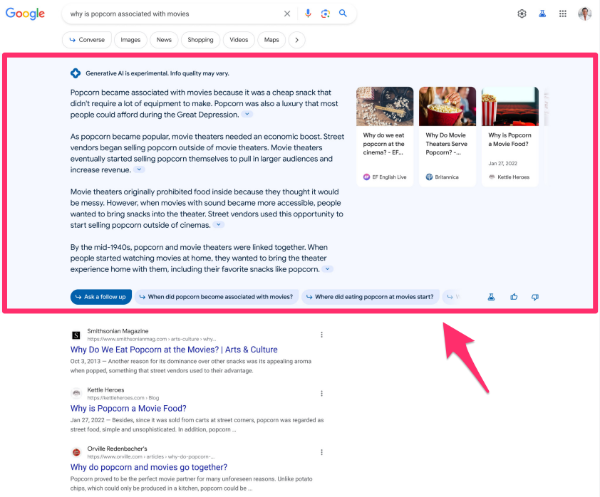

A Google SGE pedig még közelebb hozza mindenkihez az AI-alapú keresést, hiszen a hagyományos “tízes találati oldalakon” kínálja a mesterséges intelligencia által generált válaszokat. Egy vizsgálat szerint, ha már be van kapcsolva az opció az adott felhasználónál, akkor a keresések 86,83 százalékában jelenik meg valamilyen SGE-elem a találati oldalakon.

Viszont az ebben megjelenő linkek csak az esetek egy egészen kis töredékében (4,5%) egyeznek a találati oldal első oldalán egyébként megjelenő linkekkel, vagyis ebből az következik, hogy teljesen más a SEO-ja, mint az eddig megszokott. Ráadásul az AI válasza a hagyományos 10 találatot jelentős mértékben lejjebb is tolja az oldalon, gyakorlatilag kiszorítja hajtás alá.

Nálunk ez még inkább a jövő zenéje, ugyanakkor felmerül a kérdés, hogy milyen hatással lesz ez - illetve úgy összességében az AI térnyerése a kereséseknél - a weboldalak forgalmára nézve. Attól most tekintsünk el, hogy a Google algoritmusfrissítései az egyes weboldalak forgalmát legalább ennyire, ha nem még inkább veszélyeztetik - sok esetben megfejthetetlenül - mostanában, és már ez bizonytalanná teszi, hogy érdemes-e SEO-erőfeszítéseket tenni, hanem nézzük, mik a lehetőségek a mesterséges intelligencia korában.

Felére csökkenő organikus forgalom a weboldalakon

Talán nem meglepő, hogy a Gartner azt jósolja, hogy a weboldalaknak a találati oldalakról származó organikus forgalma 2028-ra a felére fog csökkenni. Eddig az átlagos weboldalak esetében a forgalom 53 százaléka érkezett organikus keresésekből, ráadásul ez az organikus forgalom sok esetben jó minőségű forgalom volt, különösen a long tail kulsszavaknál, melyeket az SGE igencsak veszélyeztet a jellege miatt. A cég azonban 2028-ról beszél, egyelőre az átlagos magyar felhasználó nem találkozik az SGE-vel, mely még akkor sem jelenik meg egyébként minden találati oldalon, ha valaki használhatja már és regisztrált a Google Labsben.

Ugyanakkor az eddigiek alapján az már látható, hogy az SGE használata vonzó lehet majd, hiszen a korábbinál összetettebb felhasználói kérdésekre is képes lesz választ adni. Ráadásul egy összefoglaló információs blokkot állít össze a keresett témában egyből a hajtás felett a felhasználó számára, akinek így nemhogy a weboldalak linkjeire nem kell kattintania, de még görgetnie sem. És persze, ha további infókat akar, mélyebben leásna bármely keresett témában, akkor persze az ajánlott linkekből válogathat, illetve kapcsolódó témákat sorol neki a Google. Nincs tehát indoka a tízes találati listát nézegetni.

Mivel az SGE-válasz lenyomja az organikus 10-es listát, ráadásul közvetlen választ ad a felhasználó kérdésére, így nagy eséllyel ezt fogják használni az emberek, ahogy eddig is jellemzően az első néhány találatra kattintottak csak. Egy másik becslés szerint mintegy 18-64 százalékos forgalomcsökkenésre számíthatnak a weboldalak a forgalomban. Hogy pontosan mekkorára, az a témától, azaz iparágtól is függ, a legnagyobb csökkenés (76%) az egészségügyi kereséseknél következhet be, ebben a témában tudja leginkább kiváltani az SGE a weboldalakra kattintgatást.

Csökkenést hoz tehát az SGE a weboldalak számára az elkövetkező években, és gyakorlatilag kilöki őket sok esetben a találati oldalakról. Így eljutunk a kérdéshez, hogy

érdemes-e még keresőoptimalizálással foglalkozniuk a weboldaltulajdonosoknak?

Különösen abban az esetben merülhet fel a kérdés, ha a fentebb linkelt egyik kutatás azon megállapításából indulunk ki, hogy nem az első találatok között szereplő oldalakról válogatja a válaszokat a Google. Ez ugyanis azt jelenti, hogy a hagyományos SEO ahhoz sem feltétlenül segít hozzá, hogy esetleg az SGE-blokkba bekerüljön az oldal linkje.

Egyelőre viszont leginkább csak feltételezések vannak a “hogyan továbbal” kapcsolatban, mindenesetre a minőségi tartalom feltehetően a továbbiakban sem lesz megkerülhető, még ha a gyakorlatban sok ellenpéldát is találtunk erre - különösen a magyar nyelvű oldalaknál -, holott ez régóta evidencia. Úgy tűnik viszont, hogy a linkek tovább devalválódnak, és azok a megoldások működhetnek a leginkább, melyek a szofisztikáltabb SEO-tanácsadások során eddig is fel szoktak bukkani.

Az biztos, hogy a jó tartalom mellett továbbra is figyelni kell a kulcsszavakra, főként a long tail kulcsszavakra való optimalizálásra, a tartalmak hasznosságára és pontosságára, melynek összhangban kell lennie a felhasználói igényekkel. A szövegek minősége is nyilván alapvető fontosságú, illetve, hogy az egyes szövegrészek önállóan is megálljanak a lábukon, mivel az AI alapvatően részleteket ragad ki egy-egy nagyobb tartalomból.

Újdonságot tehát még nem nagyon lehet mondani a korábbi SEO-tanácsokhoz képest, egyelőre működnek a régi SEO-módszerek - bár a Google váratlan hatású algoritmusfrissítései miatt ez egyre kevésbé biztos -, ennek ellenére valamennyire a jövőre is fel kell készülni, ami nem 10-20 év múlva fog gyökeresen megváltozni, hanem éppen most.